在关键业务服务器的网络架构中,仅依赖单一物理网卡存在较高风险,如硬件故障、线缆损坏或交换机端口问题都可能导致服务中断。Linux内核提供的bonding技术能将多张物理网卡组合成一个逻辑网卡,既能在故障时自动切换到备用网卡保证服务连续性,又能提升网络传输性能。

Bonding的优势

- 冗余备份: 当某一物理链路发生故障时,其他链路自动接管,保证网络连续性。

- 负载均衡: 将数据流量均匀分配到各个网卡上,提高整体带宽利用率。

- 故障转移: 在网络拥堵或硬件故障时,

Bonding能够智能切换,提高网络可靠性。 - 灵活配置: 支持多种工作模式,如

balance-rr、active-backup、802.3ad等,满足不同场景需求。

Bonding技术核心原理

工作模式全景图

- Mode 0 (balance-rr): 轮询分发数据包,最大化带宽但可能引发TCP乱序。

- Mode 1 (active-backup): 主备自动切换,保障高可用性的基础方案。

- Mode 4 (802.3ad): LACP动态聚合,需交换机配合实现智能负载均衡。

- Mode 6 (balance-alb): 自适应负载均衡,无需特殊交换机支持。

关键技术指标对比

| 模式 | 冗余能力 | 带宽叠加 | 交换机要求 | 典型场景 |

|---|---|---|---|---|

| Mode1 | 主备切换 | 单链路带宽 | 无 | 金融交易系统 |

| Mode4 | 多活冗余 | N倍带宽 | 支持LACP | 云计算虚拟化 |

| Mode6 | 多活冗余 | 近似N倍 | 无 | 中小企业网关 |

Bonding链路聚合的关键步骤

在Linux系统中,Bonding模块早已集成在内核中。接下来,我们将逐步解析如何配置和优化Bonding链路聚合。

核心模块加载

首先,需要确认系统中已经加载了bonding模块。可以通过以下命令检查:

lsmod | grep bonding

若未加载,则可以手动加载模块:

sudo modprobe bonding

Mode4动态聚合配置

# /etc/sysconfig/network-scripts/ifcfg-bond0

DEVICE=bond0

TYPE=Bond

BONDING_MASTER=yes

BONDING_OPTS="mode=4 miimon=100 lacp_rate=1"

IPADDR=192.168.1.100

NETMASK=255.255.255.0

GATEWAY=192.168.1.1

该模式需要

LACP支持

为每个物理网络接口创建配置文件,内容如下:

#/etc/sysconfig/network-scripts/ifcfg-eth2

DEVICE=eth2

BOOTPROTO=none

ONBOOT=yes

MASTER=bond0

SLAVE=yes

#/etc/sysconfig/network-scripts/ifcfg-eth3

DEVICE=eth3

BOOTPROTO=none

ONBOOT=yes

MASTER=bond0

SLAVE=yes

调整Bonding参数

根据实际需求,可以调整以下参数:

- bond-mode: 决定链路聚合的工作模式,不同模式支持不同的负载均衡和故障转移机制。

- bond-miimon: 监控链路状态的时间间隔(毫秒),提高故障检测的敏感性。

- bond-xmit-hash-policy: 在多条链路同时传输数据时,定义数据包的分发策略(主要适用于802.3ad模式)。

通过合理调整这些参数,可以在保证网络稳定性的前提下,最大化网络带宽的利用率。

小结

通过合理选择bonding模式,企业可以低成本实现网络可用性从99.9%到99.99%的跨越。当配合VLAN划分、QoS策略时,bonding更能成为SDN架构的基石。建议在实施前使用tcpreplay进行流量压力测试,确保聚合链路达到设计预期。记住,真正的网络高可用是硬件冗余、智能切换协议与完善监控体系的有机统一。

福利!!!

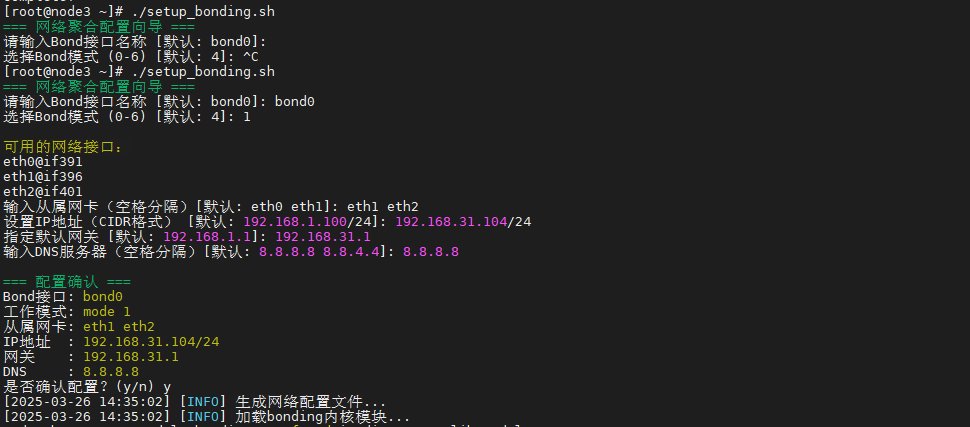

为了让大家更轻松地配置bond,我特意编写了一个通用的脚本。希望这能让整个过程变得更加简单快捷!对该脚本有兴趣的小伙伴可以关注公众号私信回复脚本链接即可获取